LMDeploy+Open Web UI部署DeepSeek

LMDeploy部署deepseek

Miniconda安装

1 | mkdir -p ~/miniconda3 |

1 | ~/miniconda3/bin/conda init bash |

1 | source ~/.bashrc |

LMDeploy下载

1 | conda create -n lmdeploy python=3.8 -y |

模型准备

1.下模地址

找到模型后赋值其名称ID即可。

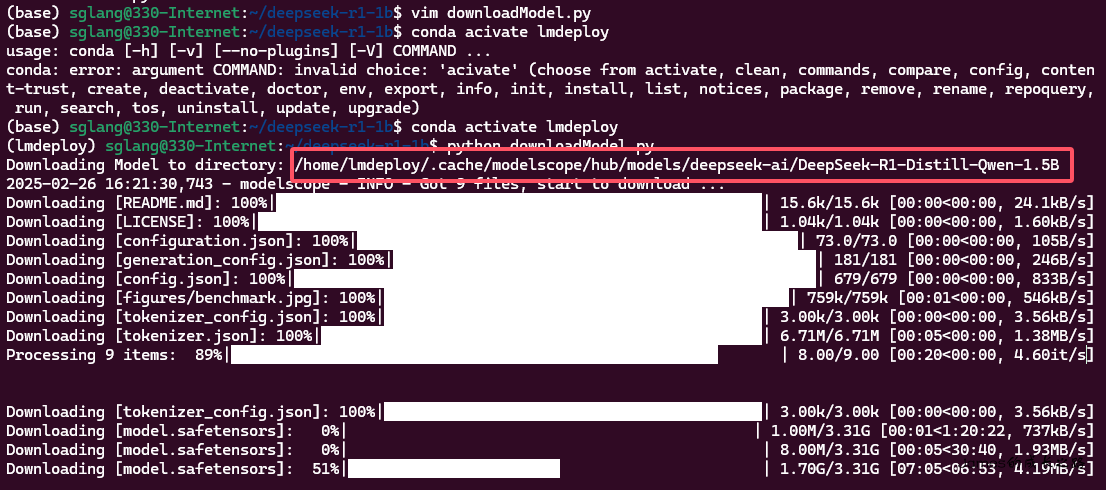

2. 模型下载

1 | #模型下载 |

保存在lmdeploy虚拟环境中运行代码,下载目录会在终端中输出。

3. 开启服务

1 | lmdeploy serve api_server /home/lmdeploy/.cache/modelscope/hub/models/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B --server-port 23333 |

4. 模型量化

如果显存不够可以对模型进行量化,这里给出int4量化的命令,量化过程中需要科学上网,在命令前传入代理地址。

1 | lmdeploy lite auto_awq internlm/internlm2_5-7b-chat --work-dir internlm2_5-7b-chat-4bit |

UI部署

UI安装

步骤 1:拉取 Open WebUI镜像

首先从 GitHub Container Registry 中提取最新的 Open WebUI Docker 镜像。

1 | docker pull ghcr.io/open-webui/open-webui:main |

第 2 步:运行容器

使用默认设置运行容器。此命令包含卷映射以确保持久数据存储。

1 | docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main |

重要标志

- 卷映射(

-v open-webui:/app/backend/data):确保数据的持久存储。这可以防止容器重启期间数据丢失。 - 端口映射(

-p 3000:8080):在本地机器的端口 3000 上公开 WebUI。

访问WebUI

容器运行后,访问Open WebUI:

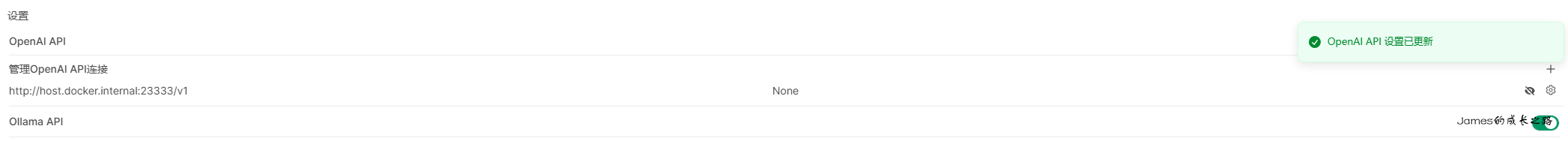

设置管理员面板配置Openai地址

URL:http://host.docker.internal:23333/v1, KEY: None

该封面图片由Long Phung在Pixabay上发布

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来自 James的成长之路!

评论